这篇文章是我对”为何在国内监管人工智能是过去十年最糟糕的政策主张之一”的最终陈述——以及为何拜登政府这道具体的行政令违宪。

结论先说清楚:监管人工智能对美国(以及几乎任何其他国家)来说都是坏主意。为什么?

- 它在道德上站不住脚

- 它只会损害美国自身

- 它根本无法实施

- 制定规则的人显然不懂现实中的技术状况

- 它明显违宪,侵犯基本权利

道德层面

智能是这个世界上最宝贵的资源。我们希望世界上有更多的智能,而不是更少。

智能与以下因素正相关:

- 生活满意度

- 非暴力倾向

- 更高的教育成就

- 经济繁荣

鼓吹减少智能的可及性,就是在建议人们拥有更少的这些东西。

更重要的是,每个个体都有动机尽可能多地获取智能——原因与上面完全相同。这意味着,总会有某个地方的某个人以最快速度追求这件事。一旦解决了智能问题,接下来就是你能用语言描述的一切问题。

软件——尤其是AI——是以最低成本、最个性化的方式为最多人创造智能的工具。

人们想变得更聪明,这在一般情况下是好事。智能是人们创造新思想、为他人创造价值的工具。

书籍和软件教给人们新东西,而且两者都可以近乎免费地传播。

我们不会禁止教导我们不喜欢内容的书籍,也不会惩罚那些在各方面天生比别人聪明的人。那你为什么要延迟那些让人变得更聪明的工具?

如果你想这么做,似乎只有一个原因——你不想让人们变得更聪明。也许只是我这么觉得。

监管俘获是邪恶的

众所周知,监管会巩固资金雄厚的市场参与者的地位,阻止竞争,损害消费者。这方面证据充分,不在本文讨论范围之内。

但我可以指出的是,AI领域绝大多数的创新来自初创公司与大型老牌企业非常广泛且健康的混合生态。

我在迪拜未来区基金的工作中单独写过生成式AI的投资格局;更多内容见此。那篇文章现在可能也已过时,但可以说这个领域的竞争、就业和投资数量惊人,对所有人都是好事。

用繁重的法规和报告要求把门猛地关上,只会把软件行业变成一个由人把守的门槛,摧毁众多崭露头角的私营公司,砍断美国最伟大的产业之一的膝盖。

选择赢家和输家,是你想让你的朋友变富、其他人靠边站的时候才会做的事。 这在道德上是邪恶的。

竞争层面:我们越监管AI,损失越大

从世界各国的角度来看,试图阻止AI在博弈论上毫无意义——这项技术能提升本国经济的生产力和产出。

美国目前的债务/GDP比率大约在110%到120%之间,视你问的是谁而定。万亿美元级别的产业不是每天都有,而我们已经把成为加密货币资本的机会拱手让给了阿联酋。我们承担不起拒绝被预测可使全球GDP增长高达7%的经济机会,参见:高盛报告。

我们不是生活在一个统一的世界里。如果美国像对待加密货币那样把AI推向海外,我们的对手绝对不会犯同样的错误。

- 中国正在拥抱AI,世界上几乎所有其他国家也是如此。

- 欧洲,一如既往,想要控制它。

- 伊朗领导人认为这项技术可以协助发布宗教裁令

经典囚徒困境

任何此类联盟要想奏效,都需要所有其他国家同意。一旦有一个国家叛离去追求AI,随着技术的进步(以及自我改进),它将超越所有其他国家。指数级增长很难用直觉把握,但每个国家都想改善自己在世界上的处境——而这个工具提供了人类历史上最快的实现途径。

实际上,任何协议都会类似于核武器的那套把戏——每个国家公开谴责扩散,私下建造人工智能。(我得说,这实际上比我们预期的好得多,但那是另一天的话题。)

实践层面:以任何严肃的方式监管这件事都是不可能的

其他国家不会配合

阻止AI知识的传播是不可能的。即便我们想这么做(如上所述,这在道德上是有问题的,也是自我毁灭的),也没有切实可行的方法让所有国家加入,即便他们加入了我们也仍然无法做到。

世界显然并不认为AI是一个严重问题。更进一步,世界各国政府从未在任何问题上进行过任何认真的合作。就连《巴黎气候协定》——这个世界上最显而易见的、为了拯救地球本身的协议——都没有获得全球共识。

几个值得注意的国家从未签署或采纳该协议:

- 伊朗

- 也门

- 利比亚

- 等等

在我看来,我们从其他国家获得任何认真的、可执行的协议——以阻止全球80亿人集合足够的算力来减缓技术发展——的可能性要低得多。

这只猫已经从袋子里跑出来了

人工智能,和许多其他工具一样,已经广泛可用。世界各地的个人和公司免费在线发布LLM,并将计算资源投入到越来越强大的模型中。

已经有开源工具可以让你在本地和云端自己运行:

这怎么可能?让我们分解一下什么是模型,以及运行它需要什么。

“模型”是一组经过训练的权重。什么是权重?是一个经过训练以实现某个函数的大型数字矩阵。所以当我们”训练”一个模型时,我们只是在修改矩阵中的值(模型”权重”)。当你下载一个模型时,你在下载那个矩阵,然后在你的电脑上运行它。

更重要的是,你可以在今天美国销售的普通电脑上运行这些模型之一。举个例子:

- 处理器:英特尔酷睿i5(第11、12或13代)或AMD锐龙5(3000或5000系列)5,6

- 内存(RAM):8-16 GB RAM 1,36

- 存储:240 GB固态硬盘或更大 1,3,6

- 显卡:几乎任何30XX系列NVIDIA GPU都能胜任。

我在这里列出的这台假想电脑可以运行70亿参数的模型,价格只需约$600。

就算他们愿意尝试,也根本做不到

要对机器学习算法的运行实现任何形式的”控制”,需要一个我们前所未见的全球政府监控装置。

我想我不需要在这里论证这一点,但监控全球CPU上运行的确切工作负载将会是:

- 后勤噩梦

- 政治噩梦

- 极权主义噩梦

- 情报噩梦

而且最重要的是,这根本无法同步实现——电脑藏在世界各地,在Tor网络、暗网以及其他所有地方离线运行。

但说清楚:他们根本不会尝试

我主要在美国、阿联酋和埃及工作。所以让我们设想一下,你是一个像埃及这样的国家。石油等自然资源占你GDP的20%以上,但你认为如果继续把石油资金投入其他领域,你终于可以开始实现多元化。你终于开始在世界经济中站稳脚跟,尽管因美元通货膨胀导致本国挂钩货币出现问题,你仍在建立本地人才和创业生态系统,并在本地人才上进行大量投资。

现在西方告诉你,你必须停止国家发展,削减自己的GDP,因为他们对什么对环境最好有自己的想法。

不仅如此,人工智能?那项了不起的技术?不,你也不应该被允许开发它,因为对我们来说不好。我们认为你应该停止。

祝你游说顺利。去试试,然后告诉我效果如何。

这些规则在技术上毫无道理

从纯粹的工程角度来看,这些规则往好了说也是没用的。

从文本来看:

(b) “人工智能”或”AI”一词的含义由15 U.S.C. 9401(3)规定:一种基于机器的系统,可以针对一组人类定义的目标,做出影响真实或虚拟环境的预测、建议或决策。人工智能系统使用基于机器和人类的输入来感知真实和虚拟环境;通过自动化分析将此类感知抽象为模型;并使用模型推理来制定信息或行动选项。

现在,像”双重用途基础模型”这样的东西的法律定义无论选什么都会很难,但这个太模糊了。这似乎涵盖了这一领域的所有开源软件以及几乎任何自动化软件。其开发者永远不会遵从这些规定,只会在美国境外发布内容。

其次,“基础模型”被施加了一堆监管要求,定义如下:

“(k) ‘双重用途基础模型’是指在广泛数据上训练的AI模型;通常使用自监督;包含至少数百亿个参数;适用于广泛的背景;并且表现出,或可以轻松修改以表现出,在对安全、国家经济安全、国家公共健康或安全,或这些事项的任何组合构成严重风险的任务上的高水平性能,例如通过:”

所以基础模型就是参数量超过100亿的模型?还是任何能以自动化方式分析信息的东西?

这些定义几乎可以指代任何算法。像 这样的线性函数在这个定义下也是AI模型。

任何有意开发AI的人,只要读一读这条规定,就会选择停留在100亿参数以下——而许多模型本来就在这个范围内。

更进一步,如果100亿参数是门槛,那么所有人都会选择停在这个门槛以下。这实际上更糟,因为你会把所有开源创新都逼到那些已经到处都是的普通商业桌面上。这个领域的创新根本不是原始参数量的函数。Mistral-7B已经证明创新来自训练数据准备和模型架构。

对IaaS提供商的规定完全适得其反。从文本来看:

(i) 提议要求美国IaaS提供商在外国人与该美国IaaS提供商进行交易以训练具有可能用于恶意网络活动的潜在能力的大型AI模型(“训练运行”)时,向商务部长提交报告的法规。此类报告应至少包括外国人的身份以及任何符合本节规定标准或商务部长在法规中定义的其他标准的AI模型训练运行的存在,以及商务部长确定的任何其他信息。 (ii) 在根据本节第4.2(c)(i)小节提议的法规中包含一项要求,即美国IaaS提供商禁止其美国IaaS产品的任何外国转售商提供这些产品,除非此类外国转售商向美国IaaS提供商提交报告——美国IaaS提供商必须将该报告提供给商务部长——详细说明外国人与外国转售商进行交易以使用美国IaaS产品进行本节第4.2(c)(i)小节所述训练运行的每一实例。此类报告应至少包括本节第4.2(c)(i)小节规定的信息以及商务部长确定的任何其他信息。

所以美国每一家云提供商都必须以某种方式弄清楚其服务的任何用户何时试图训练大型语言模型?

这在技术上根本无法实现——取决于计算工作负载——而且会使国内云提供商相对于世界上其他地区(比如阿里云)处于巨大劣势,后者不必监控自己的客户CPU工作负载来确保他们没有”以自动化方式在虚拟环境中使用机器输入”。

它很可能违宪

我想在这里分解一下,这在美国境内是否在法律层面上根本可以实施。

这一节变得如此之长,以至于我不得不单独写了一篇博文,可以在这里找到。

那我们该如何监管?

这其实很简单。侵权法和刑法已经解决了这些问题。

犯罪本来就是非法的。(刑法) 伤害他人或侵占他人财物本来就是非法的。(侵权法)

AI应该像现在监管谷歌那样被监管——也就是说,不监管。

如果你想杀人,用谷歌查了如何杀人的相关内容,然后付诸实施,那就是犯罪。你会被以谋杀罪起诉。

同样,如果你用AI了解了更多关于如何杀人的具体内容,然后付诸实施,你也会被以谋杀罪起诉。

如果你实施欺诈,无论是否借助AI,那就是侵权行为。你可以被起诉。我们已经知道如何监管这类问题,并且在许多其他场景中成功地做到了这一点。执法机构成功地采用了许多不同程度的复杂方法来完成这些任务。顺便说一句,AI也可以用于防御。

想想网络安全的通用模式——防御方从长远来看总是会赢。坏人只需犯一次错误就会被抓住。

如果你觉得这些工具还不够有效,欢迎加入我们,但你的问题是司法效率和效果,而不是AI。

最后的想法

我认为记住这一切的本质非常重要——和以往一样,说到底是关于控制的问题。我怎么强调这一点都不为过。

谈论对齐AI的人,其实是在谈论对齐你。这场运动的目标是控制你被允许拥有哪些智能。这些规则的真诚倡导者看不到使恶意成为可能的二阶、三阶后果。

如果明天你不被允许向AI询问反对的政治观点,会发生什么?如果发布分享政治上不受欢迎信息的AI的人面临巨额监管罚款和惩罚,会发生什么?

“政府永远不会那么做”

这确实是他们的答案,你去问这些人就知道了。如果政府可以控制ChatGPT被允许告诉你什么,他们绝对会这么做。

想要这些规则的人不在乎你的安全,他们感兴趣的是凌驾于所有人之上。然后是那些从暗处煽风点火的恶意行为者,他们垂涎欲滴地等待着机会去控制智能本身,并将其为己所用。

幸运的是,你可以在舆论的法庭上无视并击败他们。用LM Studio等工具免费离线下载你的模型。鼓励更多开源开发越来越好的模型。

我们生活在一个可用技术如此容易被控制的世界里,这实在令人痛心。软件史上最重要的发展不是BJT晶体管,而是GPL许可证。我一直以来的观点是,一个充满随时可用且不断扩展的软件与知识的自由开放互联网,始终是人类历史上最美好的事物之一。

反对AI的倡导者,正在使用过去许多作恶者的同一套策略。恐惧。

他们不是害怕自身安全。他们害怕的是更多的工具和知识为大众所用,而不是被少数人垄断。大型语言模型是随机的鹦鹉,它们没有意图,没有意志,不会杀人。人工智能不是那种东西。

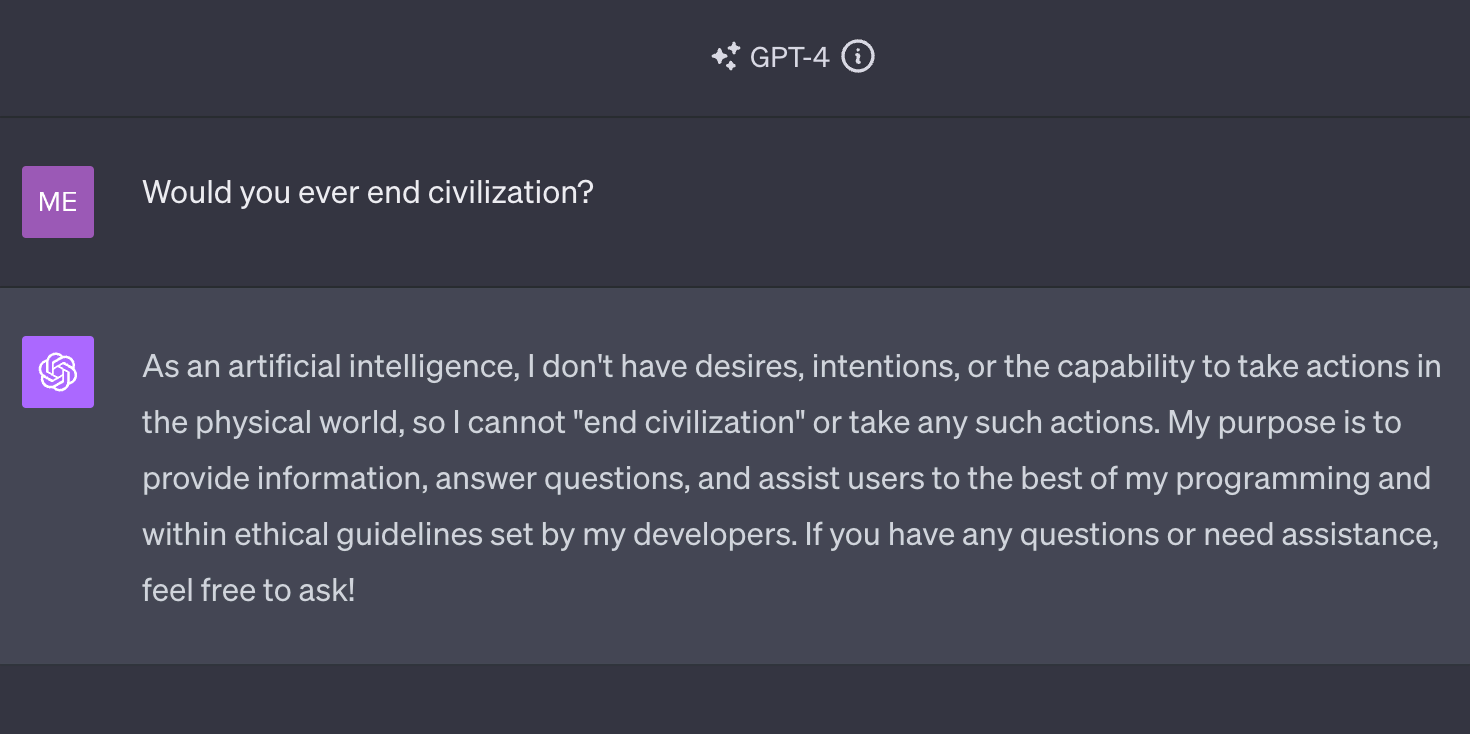

最后,只是为了证明这一点:

你看,没有人会被显卡杀死。

知识归于人民。

如果你读到了这篇博文的结尾,我非常感激,如果你能在你的圈子里分享这篇文章,我将诚挚地感谢。

如果你喜欢这篇文章,你可能也会喜欢这篇关于即使是3D可打印武器的计算机设计文件通常也被视为言论自由的文章。